در این مقاله جامع، ما جعبه سیاه مدلهای زبان بزرگ را باز میکنیم. قدم به قدم، از مفاهیم پایهای مثل توکن تا معماری پیچیدهای به نام ترنسفورمر را با هم رمزگشایی خواهیم کرد. به شما قول میدهیم پس از خواندن این مقاله، درک شما از هوش مصنوعی مولد، از یک ناظر کنجکاو به یک کاربر آگاه و متخصص تغییر خواهد کرد. پس لطفا تا انتهای مقاله با ما همراه باشید.

هوش مصنوعی مولد GenAI چیست؟

بیایید از ابتدا شروع کنیم. هوش مصنوعی فناوری است که به ماشینها توانایی انجام کارهایی را میدهد که معمولا به هوش انسانی نیاز دارد، مانند یادگیری، استدلال و تصمیمگیری. حالا هوش مصنوعی مولد یا Generative AI نوعی از هوش مصنوعی است که محتوای کاملا جدید و اصیل تولید میکند، مثل متن، تصویر، موسیقی، ویدیو یا حتی کدهایی که قبلا وجود نداشته است.

تفاوت هوش مصنوعی سنتی و هوش مصنوعی مولد

تا همین چند سال پیش، هوش مصنوعی عمدتا برای تحلیل دادهها و دستهبندی طراحی شده بود و نمیتوانست چیزی جدید بسازد.

هوش مصنوعی سنتی Traditional AI:

این سیستمها دادههای موجود را بررسی میکنند و الگوها را تشخیص میدهند، اما هیچچیز جدیدی خلق نمیکنند.

- مثال ۱: طبقهبندی تصویر یک مدل سنتی هزاران عکس را میبیند و تشخیص میدهد کدام عکسها حاوی گربه هستند (مثل سیستم تشخیص چهره در فیسبوک).

- مثال ۲: فیلتر اسپم ایمیل ایمیلهای شما را اسکن میکند و بهسرعت مشخص میکند کدامها اسپم هستند (مثل فیلتر جیمیل).

این مدلها در درک و تصمیمگیری بر اساس دادههای قبلی عالیاند، اما در خلق محتوا ناتواناند.

هوش مصنوعی مولد Generative AI:

این نسل جدید نه تنها تحلیل میکند، بلکه محتوای کاملا جدید و اصیل تولید میکند، از متن و تصویر گرفته تا موسیقی و کد.

- مثال ۱: تولید متن با وارد کردن پرامپت “یک داستان کوتاه ترسناک درباره جنگل برای نوجوانان بنویس”، یک رمان کوتاه کامل و خلاقانه مینویسد (مثل ChatGPT).

- مثال ۲: تولید تصویر با پرامپت «گربهای با کلاه جادویی در فضا»، یک تصویر هنری و منحصربهفرد خلق میکند (مثل Midjourney یا DALL-E).

- مثال ۳: تولید موسیقی با درخواست «آهنگ راک ۳ دقیقهای درباره آزادی»، یک قطعه کامل با ملودی و شعر میسازد (مثل Suno).

- مثال ۴: تولید کد با پرامپت “یک اسکریپت پایتون برای تحلیل دادههای فروش بنویس”، یک کد قابل اجرا و بهینه مینویسد (مثل GitHub Copilot).

هوش مصنوعی سنتی تشخیص میدهد، اما هوش مصنوعی مولد میآفریند.

مدل زبانی بزرگ LLM کجای این داستان قرار دارد؟

اگر هوش مصنوعی مولد را یک کارخانه بدانیم، مدلهای زبانی بزرگ، ستون فقرات و موتور اصلی این کارخانه هستند.

LLM یا Large Language Model مثل یک کتابخانه عظیم و هوشمند در مغز یک کامپیوتر است که میلیاردها کلمه، جمله و متن را از اینترنت، کتابها و مقالات خوانده و یاد گرفته است. این مدل میتواندمثل انسان حرف بزند، سوالات را جواب دهد، داستان بنویسد، کد برنامهنویسی تولید کند یا حتی ترجمه کند. فقط با دریافت یک جمله یا سوال ساده از شما.

مثلا وقتی میگویید “یک شعر درباره باران بنویس”، مدل با ترکیب الگوهایی که قبلا دیده، یک شعر کاملا جدید و زیبا میسراید. معروفترین مدلهای زبانی ChatGPT، Grok و Google Gemini هستند. به زبان ساده: هوش مصنوعی مولد یک بستر فوقهوشمند است که با یادگیری دادههای بسیار زیاد توانایی این را دارد که چطور مثل انسان فکر کند و بنویسد.

سفری به گذشته هوش مصنوعی

شاید فکر کنید هوش مصنوعی مولد یک پدیده کاملا جدید است که در چند سال گذشته ناگهان ظاهر شده. اما حقیقت این است که ریشههای این فناوری به دههها قبل، یعنی دهههای ۱۹۵۰ و ۱۹۶۰ بازمیگردد.

دهههای ۱۹۵۰ و ۱۹۶۰: چتباتهای مبتنی بر قانون

اولین نمونههای تلاش برای شبیهسازی گفتگوی انسانی، چتباتهای بسیار ابتدایی بودند. این سیستمها (مانند ELIZA) بر اساس پایگاههای دانش ثابت و مجموعهای از «قوانین» از پیش تعریف شده کار میکردند. آنها کلمات کلیدی را در ورودی شما جستجو میکردند و یک پاسخ آماده را تحویل میدادند.

مشکل چه بود؟ این روش به هیچ وجه مقیاسپذیر نبود. اضافه کردن هر قانون جدید نیازمند دخالت مستقیم انسان بود و مدل نمیتوانست چیزی فراتر از آنچه دقیقا به او گفته شده بود، یاد بگیرد.

دهه ۱۹۹۰: ظهور یادگیری ماشین Machine Learning

نقطه عطف بعدی در دهه ۱۹۹۰ اتفاق افتاد. بهجای نوشتن قوانین دقیق و برنامهریزی دستی، محققان به سمت رویکردهای آماری رفتند و یادگیری ماشین Machine Learning را به دنیا معرفی کردند.

یادگیری ماشین به سیستمها اجازه میداد تا بهجای اتکا به قوانین ثابت، خودشان الگوها را مستقیما از دل دادهها یاد بگیرند. این یک جهش بزرگ بود و مسیر را برای شبیهسازی درک زبان انسانی هموار کرد. حالا مدلها میتوانستند با تحلیل آماری متن، یاد بگیرند که کدام کلمات معمولا کنار هم میآیند.

اوایل قرن ۲۱: سختافزار قویتر و شبکههای عصبی

با ورود به قرن ۲۱، دو اتفاق مهم همزمان رخ داد:

- پیشرفت سختافزاری: پردازندههای گرافیکی GPU بسیار قویتر و ارزانتر شدند.

- توسعه شبکههای عصبی: الگوریتمهایی که از ساختار مغز انسان الهام گرفته بودند Neural Networks، به بلوغ رسیدند.

ترکیب این دو، یعنی دادههای عظیم یا همان Big Data، سختافزار قوی و الگوریتمهای شبکههای عصبی، باعث بهبود چشمگیر قابلیتهای پردازش زبان طبیعی NLP شد. نتیجه این پیشرفت، تولد دستیاران مجازی مثل سیری و الکسا بود؛ سیستمهایی که میتوانستند زبان انسانی را تفسیر کنند، نیازها را شناسایی کرده و اقداماتی را انجام دهند.

اما هنوز یک مشکل بزرگ وجود داشت: حافظه. مدلهای آن زمان در به خاطر سپردن دستورهای طولانی ضعیف بودند. اگر جملهای خیلی طولانی میشد، آنها اول جمله را فراموش میکردند!

انقلاب Transformer در هوش مصنوعی

در سال ۲۰۱۷، مقالهای سرنوشتساز با عنوان “Attention Is All You Need” “توجه تنها چیزی است که نیاز دارید” توسط تیمی در گوگل منتشر شد. این مقاله، معماری جدیدی به نام ترنسفورمر Transformer را معرفی کرد که توسط 8 نفر از محققین گوگل نوشته شده است. این معماری، همان چیزی است که T در انتهای GPT Generative Pre-trained Transformer به آن اشاره دارد و پایه و اساس تقریبا تمام مدلهای زبانی بزرگ مدرن امروزی است.

چرا Transformer همهچیز را تغییر داد؟

تصور کنید میخواهید یک جمله طولانی را درک کنید، مثل:

مردی که دیروز با دوچرخه به مغازه رفت، امروز با ماشین برگشت.

مشکل مدلهای قدیمی:

این مدلها جمله را کلمه به کلمه و به ترتیب میخواندند. مثل خواندن کتاب از اول تا آخر، بدون پرش.

- مشکل ۱: کند بودن باید صبر میکردند تا کلمه قبلی تمام شود تا سراغ بعدی بروند در نتیجه پردازش یکییکی و خیلی آهسته بود.

- مشکل ۲: فراموشی ارتباطات دور وقتی به کلمه ماشین میرسیدند، تقریبا فراموش کرده بودند که مرد با دوچرخه رفته بود! ارتباط بین کلمات دور (مرد و ماشین) از دست میرفت.

راهحل جادویی Transformer

ترنسفورمر دو شاهکار داشت:

پردازش موازی: به جای خواندن کلمه به کلمه، تمام جمله را یکجا میبیند. مثل این که شما کل صفحه کتاب را یک لحظه نگاه کنید، نه خط به خط. پس سرعت خیلی بالاتر است، مخصوصا برای جملات طولانی.

مکانیزم توجه Attention Mechanism: این سیستم مثل یک نقشهبردار هوشمند عمل میکند. به هر کلمه میگوید: تو به کدام کلمات دیگر باید توجه کنی. این توجه، مثل خط کشیدن زیر کلمات مرتبط در کتاب است. حتی اگر از هم دور باشند!

ترنسفورمرها سریعتر، دقیقتر و هوشمندتر و پایه تمام مدلهای امروزی مثل ChatGPT، Grok، Goole Gemini و Deepseek شدند. به زبان ساده:

ترنسفورمر به کامپیوتر یاد داد مثل انسان «همه جمله را با هم بفهمد و ارتباطها را گم نکند.

مدلهای زبانی بزرگ چطور فکر میکنند؟

حالا که تاریخچه و معماری اصلی را میدانیم، بیایید به سوال اصلی برگردیم: وقتی شما از یک مدلهای زبانی بزرگ سوالی میپرسید، دقیقا چه اتفاقی در پشت صحنه رخ میدهد؟

این فرآیند شگفتانگیز را میتوان به چند مرحله کلیدی تقسیم کرد.

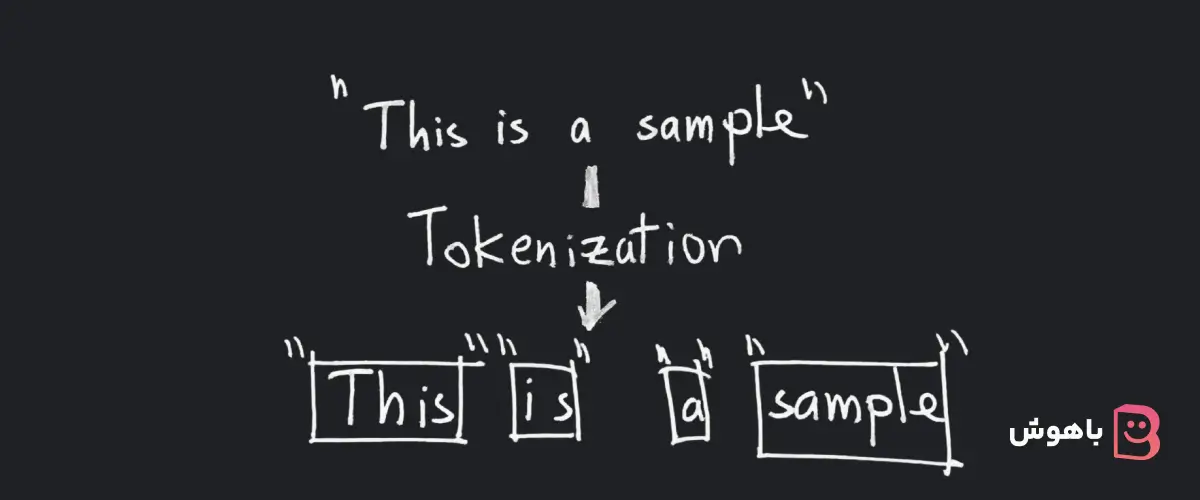

۱. توکنیزاسیون Tokenization: تبدیل کلمات به اعداد

این اولین و یکی از مهمترین مفاهیم هوش مصنوعی است. مدلهای زبان بزرگ، متن را به همان شکلی که ما میبینیم، درک نمیکنند. آنها با اعداد کار میکنند، نه با حروف.

توکنیزاسیون یعنی شکستن متن به تکههای کوچک یا همان توکن و تبدیل هر تکه به یک عدد. مدلهای هوش مصنوعی مثل ChatGPT متن را نمیخوانند. آنها فقط لیست اعداد را میبینند. مثلا عبارت “هوش مصنوعی مولد” به توکنهایی مثل [“هوش”, ” “, “مصنوعی”, “مولد”] شکسته میشود و هر توکن به یک عدد تبدیل میشود مثل ۱۲۵۴۳، ۲۲۰، ۳۴۸۹۱.

چرا توکنیزاسیون حیاتی است؟

- کارایی: پردازش اعداد برای کامپیوترها بسیار کارآمدتر از پردازش رشتههای متنی خام است.

- مدیریت واژگان: بهجای اینکه مدل مجبور باشد میلیونها کلمه را یاد بگیرد، فقط کافی است چند ده هزار توکن رایج را یاد بگیرد و کلمات جدید را از ترکیب آنها بسازد.

- محاسبه هزینه: در بسیاری از سرویسهای مدلهای زبانی بزرگ، هزینه بر اساس تعداد توکنهای ورودی و خروجی محاسبه میشود.

- محدودیت ورودی: هر مدل دارای یک Token Window یا حداکثر طول ورودی است. این یعنی مدل فقط میتواند تعداد مشخصی توکن را در یک زمان پردازش کند (مثلا 1 میلیون توکن).

۲. جادوی پیشبینی: پیشبینی توکن بعدی

اینجا به قلب تپنده مدلهای زبانی بزرگ میرسیم. بر خلاف تصور عموم، مدلهای زبانی بزرگ واقعا معنای کلمات را به شیوهی انسانی درک نمیکنند. آنها در واقع ماشینهای پیشبینی فوقالعاده قدرتمندی هستند.

وظیفه اصلی یک مدلهای زبانی بزرگ بسیار ساده است: با توجه به دنبالهای از توکنها، محتملترین توکن بعدی را پیشبینی کن. همین! کل این جادو بر اساس همین اصل ساده بنا شده است.

فرآیند پیشبینی در هوش مصنوعی چطور کار میکند؟

- شما پرامپت خود را تایپ میکنید: «بهترین فیلم تاریخ سینما…»

- مدل این متن را در اصطلاح توکنیزه میکند.(همان که در بالاتر توضیح دادیم)

- سپس از خود میپرسد: بر اساس میلیاردها متنی که خواندهام، بعد از بهترین فیلم تاریخ سینما محتملترین توکن چیست؟

- مدل یک توزیع احتمالی روی تمام توکنهای ممکن محاسبه میکند. شاید ” ” (فاصله) ۹۰٪، ” ” (نقطه) ۵٪ و ” ” (کلمه “چیست”) ۳٪ احتمال داشته باشند.

- مدل یکی از این توکنها را انتخاب میکند (مثلا ” “).

- مدل توکن پیشبینی شده (” “) را به انتهای ورودی اضافه میکند.

- حالا ورودی جدید این است: «بهترین فیلم تاریخ سینما …»

- مدل دوباره از خود میپرسد: خب، حالا محتملترین توکن بعدی چیست؟

- این فرآیند بارها و بارها تکرار میشود و مدل توکن به توکن، کل پاسخ را تولید میکند.

- بر همین اساس پرامپت تکمیل اینطور خواهد بود: بهترین فیلم تاریخ سینما چیست؟ سپس از بین محتوایی که قبلا یاد گرفته بهترین جواب را برای شما تولید میکند.

چاشنی خلاقیت: عنصر تصادفی

یک سوال مهم پیش میآید: اگر مدل همیشه محتملترین توکن را انتخاب کند، آیا خروجیهایش خستهکننده، تکراری و قابل پیشبینی نخواهد بود؟

دقیقا همینطور است! برای شبیهسازی چیزی شبیه به تفکر خلاق انسان، یک درجه تصادفی بودن یا Randomness به فرآیند انتخاب توکن اضافه میشود.

بهجای اینکه مدل همیشه توکنی با احتمال ۹۰٪ را انتخاب کند، گاهی اوقات ممکن است سراغ توکنی با احتمال ۶۰٪ یا حتی ۳۰٪ برود البته با احتمالی که بر اساس توزیع کلی تنظیم شده.

این شکل تصادفی همان چیزی است که باعث میشود که اگر یک سوال را دو بار از مدل بپرسید، احتمالا دو پاسخ کمی متفاوت دریافت خواهید کرد. همچنین باعث میشود که متن تولید شده، حس خلاقانه و جذاب داشته باشد، نه یک خروجی رباتیک و مصنوعی.

پرامپت نویسی: هنر ارتباط با هوش مصنوعی

اکنون که میدانیم در پشت صحنه چه میگذرد، بیایید در مورد نحوه تعامل ما با این مدلها صحبت کنیم. در دنیای مدلهای زبانی بزرگ، ما با دو اصطلاح کلیدی سروکار داریم:

پرامپت (Prompt):

پرامپت همان ورودی متنی است که شما به مدل ارائه میدهید. پرامپت، دستور کار شما برای مدلهای زبانی بزرگ است. این میتواند هر چیزی باشد، یک سوال ساده، یک پرامپت پیچیده Json، یا بخشی از یک متن. کیفیت پرامپت شما مستقیما بر کیفیت خروجی مدل تاثیر میگذارد. به همین دلیل است که مهندسی پرامپت یا Prompt Engineering به یک تخصص مهم این روزها تبدیل شده است.

تکمیل (Completion):

تکمیل یا Completion به خروجی اطلاق میشود که مدل در پاسخ به پرامپت شما تولید میکند. این اصطلاح از این ایده میآید که مدل در حال تکمیل کردن ورودی شما با پیشبینی توکنهای بعدی است.

در این بخش از باهوش بهترین پرامپتها را برای شما آماده کردیم

انواع رایج پرامپتهای هوش مصنوعی

پرامپتها میتوانند اشکال مختلفی داشته باشند:

پرامپتهای دستوری Instructional

شما به مدل میگویید دقیقا چه کاری انجام دهد.

- مثال: این متن را به سه نکته کلیدی خلاصه کن.

- مثال آموزشی: یک مقاله کوتاه درباره تاریخچه فوتبال بنویس.

پرامپتهای پرسشی Conversational/Question

شما سوالی را در قالب گفتگو مطرح میکنید.

- مثال: پایتخت تایلند کجاست؟

- مثال آموزشی: لویی چهاردهم چه کسی بود و چرا اهمیت دارد؟

پرامپتهای تکمیل متن Text Completion

شما بخشی از یک متن را ارائه میدهید و از مدل میخواهید آن را ادامه دهد.

- مثال: داستان از آنجا شروع شد که یک روز صبح، در جنگلی مهآلود در حالی که قدم میزدم و استرس خورده شدن توسط خرس داشتم…

- مثال آموزشی: برای کمک به یک دانشآموز کلاس چهارم ابتدایی، در نوشتن انشا، این جمله را تکمیل کن: …

پرامپتهای چندمرحلهای Chain-of-Thought

شما از مدل میخواهید که قبل از دادن پاسخ نهایی، مراحل فکر کردن خود را توضیح دهد. این کار به طرز شگفتانگیزی دقت مدل را در مسائل پیچیده مثل ریاضی بالا میبرد.

- مثال: این مسئله ریاضی را مرحله به مرحله حل کن و هر مرحله را توضیح بده.

تسلط بر هنر نوشتن پرامپتهای شفاف و مؤثر، کلید باز کردن تمام پتانسیلهای پنهان در مدلهای زبانی است.

فراتر از متن

تواناییهای هوش مصنوعی مولد در تولید متنهای خلاقانه و گرامری صحیح ، درهای جدیدی را در صنایع مختلف باز کرده است. اگرچه کاربردها بیپایان هستند، اما بیایید روی یکی از متحولکنندهترین آنها تمرکز کنیم: آموزش.

انقلاب در آموزش

هوش مصنوعی مولد این پتانسیل را دارد که آموزش را ساده، در دسترس و عمیقا شخصیسازی کند. تصور کنید یک استارتاپ آموزشی از قدرت مدلهای زبانی بزرگ استفاده کند. این استارتاپ میتواند:

- یادگیری شخصیسازی شده ارائه دهد: بهجای یک برنامه درسی ثابت برای همه، مدل زبانی بزرگ میتواند محتوای آموزشی را بر اساس سطح، سرعت یادگیری و علایق هر دانشآموز تطبیق دهد.

- دستیار معلم 24ساعته باشد: دانشآموزان میتوانند سوالات خود را در هر ساعتی از شبانهروز بپرسند و پاسخهای فوری و توضیحات تکمیلی دقیق دریافت کنند.

- محتوای آموزشی تولید کند: معلمان میتوانند از مدل بخواهند که به سرعت تکالیف، آزمونها و مثالهای تمرینی متنوعی را بر اساس یک موضوع خاص تولید کند.

- دسترسیپذیری را افزایش دهد: مدلهای زبانی بزرگ میتوانند محتوای آموزشی پیچیده را به زبانهای مختلف ترجمه کنند یا آنها را برای دانشآموزان با نیازهای ویژه سادهسازی کنند.

البته، این فناوری چالشهای خود را نیز دارد. مسائلی مانند اطمینان از دقت محتوای تولید شده، انصاف و جلوگیری از سوگیریهای موجود در دادههای آموزشی، از موارد بسیار مهمی هستند که باید به آنها پرداخته شود.

کاربردهای دیگر در دنیای واقعی

فراتر از آموزش، LLM ها در حال حاضر در این حوزهها نیز فعال هستند:

تولید محتوا و بازاریابی: نوشتن پیشنویس مقالات وبلاگ، کپشنهای شبکههای اجتماعی، ایمیلهای تبلیغاتی و سناریوهای ویدیویی.

برنامهنویسی و توسعه نرمافزار: نوشتن کدهای برنامهنویسی، پیدا کردن خطاها، توضیح کدهای پیچیده و نوشتن مستندات فنی.

پشتیبانی مشتری: ایجاد چتباتهای هوشمندی که میتوانند مشکلات مشتریان را به زبان طبیعی درک کرده و به صورت آنی حل کنند.

خلاصهسازی و تحلیل داده: خواندن اسناد حقوقی طولانی، گزارشهای مالی یا مقالات علمی و استخراج نکات کلیدی در چند ثانیه.

نگاهی به آینده و چالشهای پیش روی مدلهای زبانی بزرگ

ما در ابتدای یک دوران جدید ایستادهایم. مدلهای زبان بزرگ اوج فناوری هوش مصنوعی هستند و مرزهای ناممکن را جابجا کردهاند. در مقالههای بعدی به مدلهای مختلف و روشهای بهبود عملکرد آنها پرداخته خواهد شد.

اما این مسیر بدون چالش نیست. همانطور که اشاره کردیم، مسائلی مانند توهم یا خیالبافی، سوگیریهای نژادی، جنسیتی و فرهنگی که از دادههای آموزشی اینترنت به ارث برده، و همچنین مصرف انرژی و هزینههای محاسباتی عظیم، موانعی هستند که باید بر آنها غلبه کنیم.

با این حال، پتانسیل این فناوری برای حل مشکلات بزرگ بشری، از آموزش شخصیسازی شده گرفته تا تسریع اکتشافات علمی، غیرقابل انکار است.

شما، معمار آیندهاید

سفر ما در این مقاله تقریبا به پایان رسید. ما از چتباتهای ساده دهه ۱۹۶۰ شروع کردیم، شاهد ظهور یادگیری ماشین در دهه ۱۹۹۰ بودیم ، از شگفتی معماری ترنسفورمر گفتیم ، و در نهایت به قلب LLM ها نفوذ کردیم تا بفهمیم چگونه توکن به توکن، جادوی پیشبینی و کمی شانس، این گفتگوهای هوشمند را خلق میکنند.

ما یاد گرفتیم که پرامپت ما، کلید این گفتگو است و تکمیل مدل، پاسخی به آن.

تبریک! شما حالا فقط یک کاربر معمولی نیستید. شما مفاهیم اولیه و اساسی هوش مصنوعی را درک کردهاید. میدانید که پشت این رابط کاربری ساده، چه فرآیند پیچیده و شگفتانگیزی در حال وقوع است. این دانش، به شما قدرت میدهد تا از این ابزارها به شکل مؤثرتری استفاده کنید.

سوالات متداول (FAQ)

تفاوت اصلی هوش مصنوعی مولد با هوش مصنوعی سنتی چیست؟

هوش مصنوعی سنتی عمدتا بر تحلیل و طبقهبندی و تصمیمگیری درباره دادههای موجود تمرکز دارد. اما هوش مصنوعی مولد، محتوای کاملا جدید و اصیل خلق میکند که قبلا وجود نداشته است.

مدل زبانی بزرگ (LLM) دقیقا چیست؟

LLM نوعی هوش مصنوعی است که بر روی مقادیر عظیمی از دادهها آموزش دیده است. این مدلها در درک، خلاصهسازی، ترجمه و تولید زبان انسانی با جزئیات و روانی شبیه به انسان، تخصص دارند.

چرا توکنیزاسیون Tokenization اینقدر مهم است؟

توکنیزاسیون فرآیند تبدیل متن به قطعات عددی است. این فرآیند حیاتی است، زیرا مدلهای کامپیوتری با اعداد بسیار کارآمدتر از متن خام کار میکنند. همچنین، نحوه محاسبه هزینهها و محدودیت ورودی مدل بر اساس توکنها است. اگر در آینده بخواهید برای استفاده حرفهای از هوش مصنوعی، از سرویسی API بگیرید و از آن استفاده کنید، باید خیلی دقیق مفهوم توکنیزاسیون را بلد باشید تا در مصرف توکنها بهینه عمل کنید و صرفهجویی کنید.

منظور از پرامپت Prompt و تکمیل Completion چیست؟

پرامپت ورودی یا دستوری است که شما به LLM میدهید. تکمیل خروجی یا پاسخی است که مدل در جواب پرامپت شما تولید میکند.

آیا مدلهای زبانی بزرگ واقعا خلاق هستند یا فقط کلمات را تکرار میکنند؟

خلاقیت در مدلهای زبانی بزرگ از طریق افزودن یک عنصر تصادفی به فرآیند پیشبینی توکن بعدی شبیهسازی میشود. بهجای انتخاب قطعی محتملترین کلمه، مدل با درجهای از عدم قطعیت، کلمات دیگر را نیز انتخاب میکند. این باعث میشود خروجیها متنوع، غیرقابل پیشبینی و اغلب خلاقانه به نظر برسند.

ما در باهوش معتقدیم که این فناوری متعلق به همه ماست. حالا که درک عمیقتری از نحوه کار مدلهای زبانی بزرگ دارید، بیشترین چیزی که در مورد این فناوری شما را شگفتزده کرده چیست؟ آیا کاربرد خاصی در ذهن دارید که فکر میکنید هوش مصنوعی مولد میتواند در آن انقلابی ایجاد کند؟ دیدگاهها و سوالات خود را در بخش نظرات با ما به اشتراک بگذارید.